上海硅知识产权交易中心有限公司(SSIPEX)是工业和信息化部、上海市为促进我国集成电路设计业成长,提升电子信息产业知识产权水平,培育物联网等新兴产业发展而建立的行业性公共服务机构之一。

Shanghai Silicon Intellectual Property Exchange Co., Ltd. (SSIPEX)was founded by the Ministry of Industry and Information, Shanghai Municipal Commission of Economy and Informatization. It is one of the industrial public service organizations to improve China's IC design industry, to boost intellectual property level of electronic information industry and to foster new industry such as internet of things

来源:上观新闻 作者:俞陶然

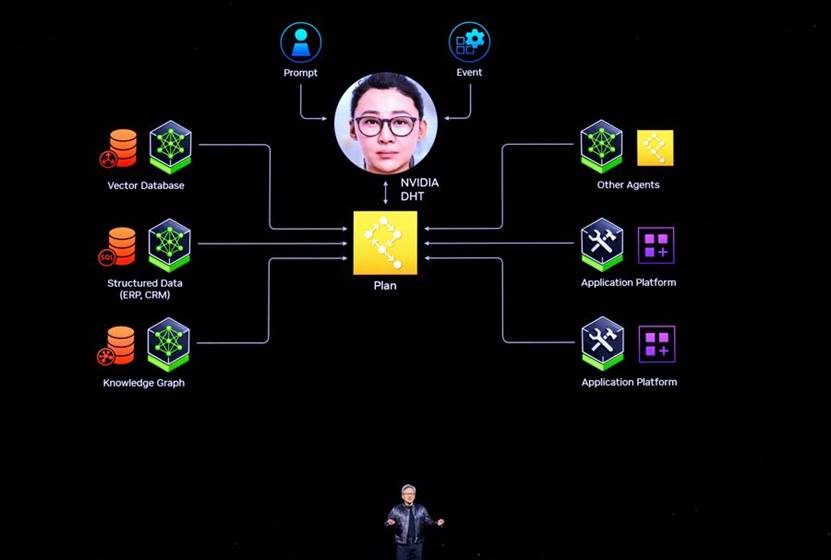

人工智能大模型的兴起,让英伟达公司成为全球最受关注的企业之一。最近,英伟达首席执行官黄仁勋宣布:Rubin将是Blackwell芯片的后继平台。今年3月18日,这家硅谷企业发布了Blackwell芯片平台,刚进入生产阶段。为何在两个多月后,就急着官宣下一代还在研发的人工智能芯片?人工智能芯片技术和产业的发展趋势是什么?解放日报·上观新闻记者采访了上海硅知识产权交易中心总经理、上海市集成电路行业协会监事长徐步陆博士。

对GPU应用前景“先知先觉”

据介绍,人工智能芯片以GP-GPU通用计算芯片为主体。GP的意思是通用,GPU的本意是图形处理器,所以GP-GPU的全称为“通用图形处理单元”,简称GPU。正是因为在这个芯片领域做到世界第一,英伟达才超越英特尔,成为全球最炙手可热的芯片公司。

GPU在个人电脑、手机和平板电脑里就有,用来处理与图像相关的运算。这类芯片有并行计算功能,能够在同一时间做大量比较简单的运算,在人工智能大规模计算上大有用武之地。凭借对这一应用前景的“先知先觉”,黄仁勋带领团队将GPU升级为GP-GPU,让这类芯片更适合高性能并行计算,并能使用更高级别的编程语言。

今年3月18日,黄仁勋在英伟达开发者大会上演讲。(新华社/法新)

随着人工智能产业的兴起,高性能GP-GPU的应用价值越来越大。这类芯片主要应用在人工智能模型训练与推理、高性能计算两大领域。在大模型训练中,用于训练的GPU往往部署在云端,即安装在服务器里,注重绝对的计算能力;用于推理的GPU则注重综合指标,用于云端或设备端,需通盘考虑单位能耗算力、时延、成本等因素。

在高性能计算领域,GPU也扮演着重要角色,用于数据中心、科学计算、自动驾驶等多种应用场景,能执行海量数据的并行计算。

英伟达产品是芯片级服务器

“很多人对人工智能芯片有个误解,以为有了GPU,就不需要CPU了。”徐步陆说,“其实,GPU和CPU各有所长。简单讲,前者擅长并行计算,后者有复杂逻辑的控制功能。”以英伟达今年3月发布的GB200芯片为例,它由两个B200 Blackwell GPU和一个基于Arm公司芯片架构的Grace CPU组成,采用台积电4纳米工艺制程,包含2080亿个晶体管,其性能达到每秒20千万亿次浮点运算。

GPU与CPU、存储器等不同种类裸片集成为单颗芯片,称为芯片级“异构”。在存算一体化过程中,合理优化分配GPU、CPU、加速单元等异构处理器、存储和传输之间的任务和负载,是人工智能芯片技术发展的一个趋势。黄仁勋最近宣布在研的Rubin芯片,将配备新一代GPU、基于Arm架构的Vera CPU以及HBM4高带宽存储器,就体现了这一趋势。

“从本质上看,英伟达做的产品不单是芯片,而是芯片级服务器,为客户提供‘片上计算系统’等智能计算解决方案。”徐步陆告诉记者。

英伟达公司标识(新华社/路透)

提前官宣有利于产业链协同

在服务器领域,英伟达为谷歌、微软、亚马逊等云服务巨头企业供货,同时也对这些传统巨头形成了挑战。另外,英伟达也要应对AMD、英特尔等芯片企业向它发起的挑战。在这种激烈的市场环境中,黄仁勋在发布Blackwell芯片平台后的三个月内,急着官宣下一代人工智能芯片,也就不难理解了。显然,适时推出人工智能硬件产品路线图和时间表,可以给予产业链、供应链上下游企业一个比较明确的预期,让它们根据路线图和时间表尽早谋划自身产品。

超前官宣下一代人工智能芯片,还能引起资本市场的关注,有助于英伟达维持3万亿美元这一科技公司的历史性市值,筹集到更多的研发经费。徐步陆指出,集成电路产业在全球资本的保障下,处理器、存储器、传输光模块等芯片在设计上越来越同步,芯片设计与尖端制程的晶圆制造、三维立体封装正在形成高效协同,算力芯片与传输协议、开发环境的协同性也越来越高。

今年3月18日,黄仁勋发布人工智能芯片B200。

(新华社/法新)

在协同性方面,人工智能芯片与通用并行计算架构生态系统的优化协同值得一提。英伟达开发的CUDA,就是一个通用并行计算架构生态系统。它包含CUDA指令集架构和GPU内部的并行计算引擎。软件工程师可以用C语言来为CUDA架构编写程序,让这些程序在支持CUDA的处理器上高性能运行。

“这是一个编程平台、应用框架和基础架构。”徐步陆解释,“通过软件和硬件产品的协同,英伟达打造了强大的GPU创新生态,吸引全球用户在这个生态里开发AI产品并优化开发工具、算子库等,从而越用越好用,以致产生用户依赖性。”

放眼国内,华为等一批人工智能芯片头部企业也在开发生态系统。虽然目前国产生态系统的用户数量不如CUDA,但国内集成电路业界已达成一种共识:只有加快构建开放式新一代人工智能芯片软硬件一体化生态,中国集成电路和人工智能产业才能实现自主可控、面向全球的可持续发展,也能更好地为各行业培育新质生产力服务。